Idee per testare gli Agenti AI

Per testare gli agenti AI ti suggerisco di usare la Verifica dei Checkpoint

Se hai provato a portare un agente AI in produzione, probabilmente ti sei scontrato con una dura realtà: le strategie di testing tradizionali non funzionano.

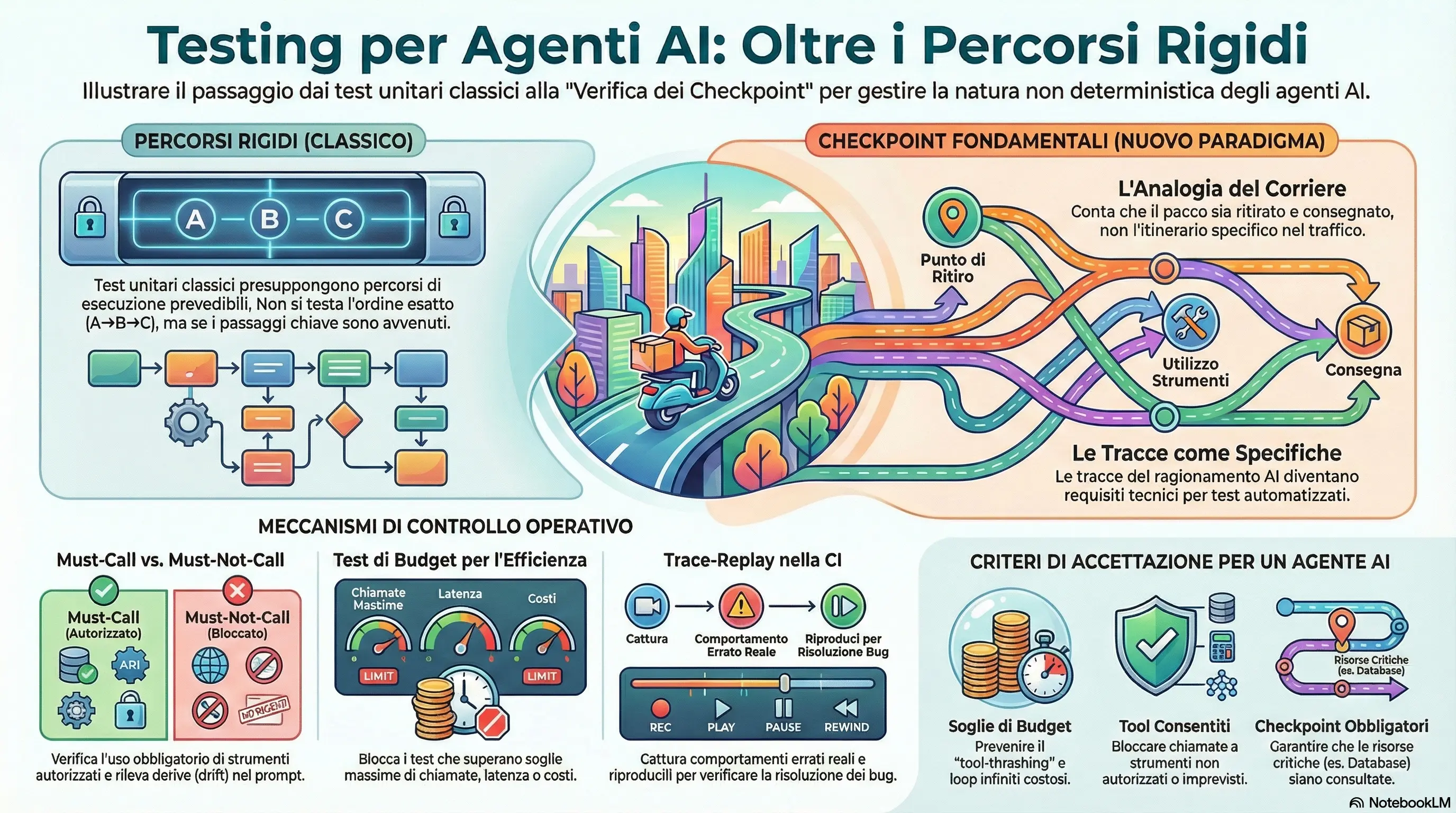

I classici unit test, che si basano su percorsi di esecuzione prevedibili e rigidi (Input A -> Output B), crollano di fronte alla natura non deterministica degli agenti intelligenti.

Il Problema: La Trappola del Determinismo

Nello sviluppo software classico, testiamo l’ordine esatto delle operazioni. Ma un agente AI è “deterministicamente libero”: può scegliere strade diverse per arrivare alla stessa soluzione. Asserire un ordine rigido di passaggi significa scrivere test fragili che falliscono anche quando l’agente ha successo.

La Soluzione: Verifica dei Checkpoint

La nuova filosofia di testing non riguarda più il come l’agente esegue il compito, ma se ha toccato i punti critici necessari, ossia la “Verifica dei Checkpoint”.

L’Analogia del Corriere:

Immagina di dover monitorare un corriere che consegna un pacco. Non ti interessa sapere se ha svoltato a destra o a sinistra per evitare il traffico (il percorso non deterministico). Ciò che conta davvero è verificare due cose: che sia passato dal magazzino a ritirare il pacco (checkpoint obbligatorio) e che non sia entrato in zone vietate (checkpoint proibito).

Per implementare questa strategia, ecco i tipi di test che dovresti integrare nella tua pipeline di CI/CD:

1. Controlli “Must-Call” (Agnostici rispetto all’ordine)

Il test deve verificare se uno strumento essenziale (es. database_lookup o create_sandbox) è stato chiamato almeno una volta durante l’esecuzione. Non importa quando, l’importante è che sia successo.

2. Controlli “Must-Not-Call” e Rilevamento Anomalie Altrettanto importante è definire cosa non deve accadere.

- Must-Not-Call: Il test fallisce se appare uno strumento vietato. Questo è fondamentale per rilevare il drift (deriva) nel prompt o nella policy dell’agente.

- Rilevamento strumenti inaspettati: Ogni task deve avere una “allow-list”. Se la traccia mostra l’uso di uno strumento non previsto per quel compito, deve scattare un errore.

3. Test di “Budget” (Anti-Thrashing) Poiché gli agenti possono entrare in loop infiniti o abusare degli strumenti, è necessario impostare tetti massimi (budget) per:

- Numero di chiamate agli strumenti.

- Latenza totale.

- Costi stimati. Superare queste soglie deve far fallire il test immediatamente, prevenendo il fenomeno del tool-thrashing in produzione.

4. Trace-Replay nella CI Una tecnica avanzata consiste nel prendere le tracce di esecuzioni reali che hanno fallito (bug in produzione) e “riprodurle” come test di integrazione. Questo assicura che, una volta corretto il prompt o la logica, quel comportamento specifico non si ripresenti.

Costruire agenti pronti per la produzione richiede di trattare le tracce del ragionamento non come semplici log di debug, ma come vere e proprie specifiche tecniche su cui eseguire test automatizzati. Passando dalla validazione dei percorsi alla verifica dei checkpoint, puoi costruire sistemi AI affidabili che mantengono la loro flessibilità senza sacrificare la robustezza.